在 AI 技術迅速發展的今日,如何以科技保存重要政治人物的思想,被視為全球公共記憶工程的新課題。會推動的「AI 李登輝」計畫,是台灣在此領域的早期實驗。新頭殼專訪基金會董事長李安妮,談她對 AI 理解的改變、知識庫建構方式與倫理原則,也揭示下一階段規劃與可能的國際合作方向。

AI 不等於複製本人:目標是準確呈現思想

她回憶說,計畫初期外界期待 AI 能「像李登輝本人」回答問題,但隨著研究深入,她愈加確定:「AI 永遠不能、也不應該取代真人。」

AI 可以模擬語氣、整理相關理念,但卻無法重建人生經驗或進行價值判斷或是要求 AI 成為「人格的分身」不僅是不可能的,也可能產生誤導。因此基金會確立三項原則:

1.不進行人格模擬,不追求複製本人。

2.不打造萬能問答機器。

3.僅依據可驗證文獻呈現思想與政策脈絡。

她強調:「我們希望可以 AI 忠實呈現文本,而不是替本尊發明新的主張。」

目前有關知識庫的架構:以原始資料為主,專家詮釋為輔。

基金會將知識庫分為兩層。第一層:李登輝留下的原始紀錄。包括著作、演講、手稿、政策文件、談話紀錄等。

李登輝的資料量極大,橫跨農業、地方治理、政治改革、外交與民主化,是 AI 的主要知識來源。

第二層:學者研究與歷史詮釋

檔案呈現的事實,但決策背景須透過後世研究予以補充。

基金會將組成跨領域「知識庫委員會」,由史學、政治、外交等專家負責資料審查與詮釋建構,避免 AI 在內容上產生誤讀。

倫理邊界:不介入當代政治 不製造新立場

李安妮表示,為避免 AI 被誤用,基金會設定四項倫理原則:不評論未成為歷史的當代政治議題,AI 不會對今日的政治人物或政策攻防表態。

她強調,所有回答皆須可追溯至文獻來源,不做推論、不創造不存在的主張。

相關資料完全存放於地端,不上雲端,避免模型被吸收、外部汙染或未授權使用。只有具有公共教育意義的對話才會被保留,日常閒聊不會成為訓練資料,確保模型不被隨意干擾。

她強調:「這不只是技術工作,也是歷史倫理工作。」第二階段工程:從語言能力走向深度脈絡互動

李安妮說,基金會規劃第二階段將重點放在三項能力提升:

(一)建立「AI 李登輝的人際網絡」

整理李登輝生前與國內外政治人物、幕僚、研究者的互動,建構人際脈絡。

這讓 AI 能夠回答「事件如何連動」、「人物如何互動」等深度問題,而非單點式資訊。

(二)讓 AI 具備「跨事件、跨脈絡」的延伸能力。

未來 AI 能主動指出事件間的關聯,並可驗證資料協助使用者理解背景,達到「帶著你一起理解歷史」的互動效果。

(三)建立國際相容的知識庫格式

若有其他國家也建置領袖 AI,只要格式相容,便有可能在研究上進行比較或對話,形成跨國的歷史資料連結。

國際合作:依需求決定深度

有關的國際合作合作可分兩層:

包括:1.技術與方法分享:展示流程、資料治理與倫理架構。

2.深度內容合作:需對方也建立完善知識庫與歷史倫理原則,才具備交流價值。

她強調,合作不是讓 AI「對話外交」,而是分享知識工程經驗。

科技不是替代 而是整理與延續

在李安妮眼中,「AI 李登輝」本質上不是再造個人,而是透過科技整理龐大歷史資料、提供更清楚的公共知識平台。「AI 永遠不是人。它的作用是協助後代理解歷史,而不是替誰說話。」

她期望這個計畫最終是能夠讓公共人物的思想,以更透明的方式來傳承,而不是成為新的權威或者是象徵。

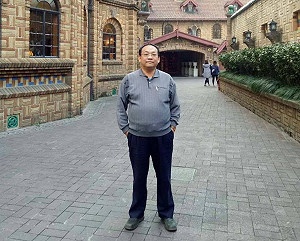

李登輝基金會董事長李安妮專訪。 圖:張良一/攝