在今(15)日凌晨的 I/O 開發者大會上,Google 以 AI 技術為核心發表主題演講。與以往不同,今年的會議並未聚焦於 Android 系統或其他 Google 服務,甚至連新一代的Android 15 系統Wear OS、Android TV 等系統均未提及,但「AI」一詞被提及了超過 121 次,2小時的內容全部將焦點集中在其創新的 Gemini 模型上。

在演講中,Google 強調了 Gemini 模型在搜尋引擎和 Google 相簿中的進一步融合,意味著用戶將能夠更直觀地與 Gemini 對話,無需輸入關鍵字即可獲得所需資訊。此外,Google 也展示了如何利用 AI 改進 Google 搜尋的功能,使得用戶僅需提出問題,AI 即可提供一份全面的資訊摘要。

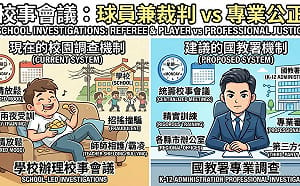

當前熱搜:辜家第四代接掌籃協!辜公怡當選新任理事長 童子瑋發聲了

此次大會還推出了名為「Project Astra」的多模型 AI 技術應用。這項技術通過視覺分析,使 AI 能夠融入手機和智慧眼鏡,透過鏡頭即時捕捉並解析現實世界的畫面,從而回答用戶的各種問題。Gemini 模型也將被整合到 WorkSpace 和 Gmail 等服務中,用戶可以通過問答互動,讓 AI 協助文件整理和資料查詢。

針對 OpenAI 最新發布的 ChatGPT-4o 模型,Google 亦為 Gemini Advanced 增添了「Gemini Live」功能,提供了更加流暢自然的語音對話體驗。用戶不僅可以選擇不同的語音風格,還能在對話中隨時打斷 AI,詢問更多細節。這種交互方式使得對話更加貼近日常生活,增強了用戶體驗。

Google在尾聲 宣布 Gemini Advanced 將新增「Gem」功能,用戶可以自訂專屬的 AI 助手。這一功能與 ChatGPT 的 Custom GPT 相似,允許用戶根據自己的需求定制 AI,無論是作為健身教練、廚房助手還是程式碼編寫者,都能以設定特定的任務和回應風格來實現使用者想完成的事項。

當前熱搜:傳輝達「N1X」PC 將問世 郭明錤推估「未來兩年出貨千萬台」 受惠族群股價先起跑

綜而言之,在今年的 I/O 開發者大會上,AI 無疑成為了焦點,與往年以 Android 系統和 Google 服務為主題的情況形成鮮明對比。Google CEO ,Sundar Pichai 也在會議的最後階段強調了這一轉變。

根據 Gemini 的統計,在首日的主題演講中,「AI」一詞被提及了超過 121 次。而 Android 15 和相關系統的詳情將延到明天的活動中公布,這在 I/O 大會的歷史上為首次發生的狀況。