近日,美國核武安全領域專家在美國媒體撰文示警,指出即便各大核武國家普遍同意「核武發射最終決策權不得交由人工智慧(AI)」,但另一個同樣攸關核戰風險的關鍵環節「核武攻擊預警系統」也不應被人工智慧主導,否則恐對全球核安全構成嚴重威脅。

提出上述警告的是美國斯坦頓核安全計畫高級研究員、現任職於美國對外關係委員會(CFR)的艾琳・D・鄧巴克爾(Erin D. Dumbacher)。她於 29 日發表評論文章,回顧冷戰時期的真實案例,強調核武預警系統一旦誤判,後果恐難以挽回。

全站首選:早想介入處理?媒體人發現:周美青和馬以南的聲明稿日期都壓在5/12

鄧巴克爾指出,1983 年冷戰高峰期間,蘇聯的核武預警系統曾錯誤顯示美國已發動核攻擊,所幸當值軍官斯坦尼斯拉夫・彼得羅夫(Stanislav Petrov)憑藉冷靜判斷,認定警報為誤報,才成功避免一場可能引發全球毀滅的核戰。她強調,這起事件凸顯「人類判斷」在核安全體系中的不可替代性。

她進一步指出,隨著人工智慧技術快速發展並逐步被引入軍事領域,其不成熟性與潛在濫用風險正對核安全穩定構成新的挑戰。即使各國普遍承諾由人類掌握核武使用的最終決策權,但若核武預警系統高度依賴人工智慧,仍可能在關鍵時刻誤導決策者。

鄧巴克爾指出,人工智慧已大幅降低深度偽造(deepfake)資訊的製作門檻,使假訊息在影像、音訊與文字層面更具迷惑性。在當前俄烏戰爭中,相關技術已多次引發輿論混亂,甚至影響到具有核武決策權的美國總統川普,相關深度偽造訊息不僅誤導其判斷,也曾被轉發擴散。

現正最夯:沈、蔣二人律師執照「含金量差很大」 他曝:誰選上賓州大學都是贏家

她同時警告,人工智慧本身仍存在輸出錯誤資訊與「演算法幻覺」的問題,若此類不可靠資訊被納入核武預警與情勢研判體系,即便最終是否動用核武仍由人類決定,也可能在極短時間內嚴重干擾人類判斷。

鄧巴克爾指出,隨著現代核武器反應時間不斷縮短,例如美國洲際彈道飛彈發射後約 30 分鐘內即可命中目標,決策者實際可用於研判的時間恐僅剩數分鐘,任何誤判都可能造成無法挽回的後果。

她呼籲,正在大力推動人工智慧軍事化應用的美國國防部,應在涉及核武層面設下嚴格紅線,包括提高資訊核查標準、明確標示人工智慧分析結果,並確保關鍵判斷環節由人類主導。同時,應培養更多能像彼得羅夫一樣,對機器輸出的資訊保持高度警覺與質疑精神的專業人員。

此外,鄧巴克爾也主張,應對美國總統動用核武的權力進行更明確的限制與制度化規範,並推動美國與其他核武國家建立暢通的危機溝通管道,以降低誤判升高衝突的風險。

她在文中警告,「人工智慧已具備誤導核指揮鏈關鍵決策者的能力,讓人誤以為遭受實際上並不存在的核打擊」,並呼籲各國應及早制定政策、落實防範措施,避免惡性錯誤資訊最終引發人類無法承受的災難。

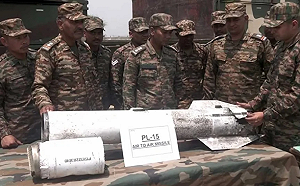

近日,美國核武安全領域專家在美國媒體撰文示警,指出即便各大核武國家普遍同意「核武發射最終決策權不得交由人工智慧(AI)」,但另一個同樣攸關核戰風險的關鍵環節「核武攻擊預警系統」也不應被人工智慧主導,否則恐對全球核安全構成嚴重威脅。 圖:翻攝自X帳號@RSIS_NTU

她呼籲,正在大力推動人工智慧軍事化應用的美國國防部,應在涉及核武層面設下嚴格紅線,包括提高資訊核查標準、明確標示人工智慧分析結果,並確保關鍵判斷環節由人類主導。 圖:翻攝自維基百科